Hay algo que me inquieta cada vez que enciendo la televisión, abro un foro de tecnología o hablo con algunas personas competentes en el ámbito técnico y educativo: hablan de la Inteligencia Artificial (generativa) como si estuviéramos a las puertas del apocalipsis (ya hemos creado a SkyNet1) o nos encontráramos con el fin del trabajo humano (como habría predicho Marx en el «Fragmento sobre las máquinas» en 18572). Ni lo uno ni lo otro. Y me parece que es hora de que alguien lo diga con claridad.

El origen de todo: Alan Turing en 1950

Hace más de setenta años, el matemático Alan Turing se hizo una pregunta aparentemente sencilla: ¿puede pensar una máquina?

Turing no pretendía responderla. Sin embargo, lo que propuso en el «Juego de la imitación3» fue algo más ingenioso: «si una máquina responde como lo haría un humano, ¿qué diferencia hay a efectos prácticos?» A ese criterio lo conocemos como el Test de Turing, y sigue siendo el mejor marco conceptual para entender qué es realmente la IA generativa de hoy.

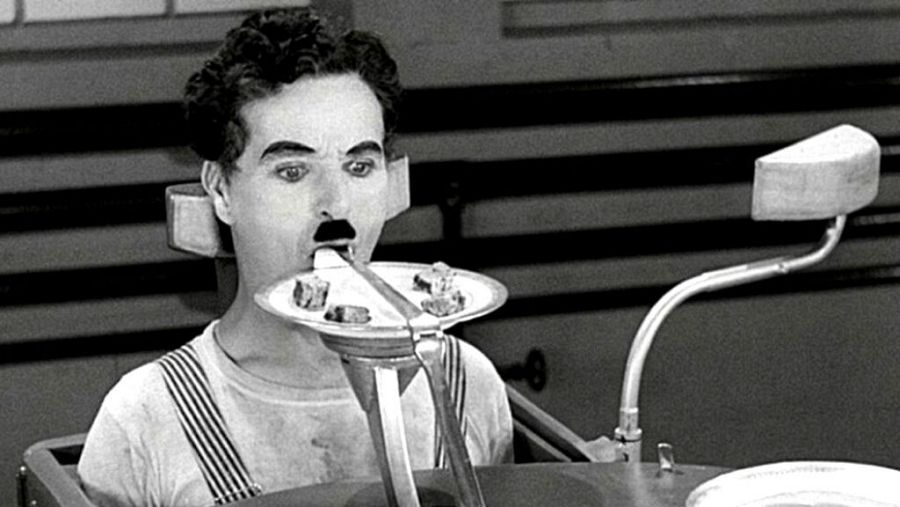

La respuesta corta es esta: la IA generativa es el arte de la imitación llevada a su máxima expresión.

No piensa. Imita los patrones del pensamiento humano con una fidelidad que nunca habíamos visto. Y eso, siendo honesto, ya es extraordinario. Pero no es lo que muchos creen que es.

¿El conocimiento humano cabe en una película en HD?

Aquí viene el detalle técnico que más me gusta explicar, porque desmonta muchos mitos de golpe.

Un modelo de IA moderno — uno grande, que podemos descargar y que podríamos ejecutar en servidores potentes — podría ocupar* tan sólo entre 60 y 150 GB. Pero aún hay más; existen versiones comprimidas que funcionan perfectamente en un portátil doméstico, ocupando apenas 4 GB.

* Cifras basadas en modelos descargables para uso libre, por ejemplo: QWen 3.6 35B – 70GB, y su versión FP32 – 163GB, GPT-OSS 120b – 65GB. Incluso Google anunció en Abril de 2026 la última versión de Gemma 4 apta para ser ejecutada en dispositivos móviles, sus versiones más potentes, como la 31b, ocupa únicamente 20GB.

¡ Cuatro gigabytes ! El tamaño de una película en alta definición (incluso podríamos guardarlo en un DVD de finales de los años 90).

Y sin embargo, ese modelo responde preguntas de medicina, derecho, historia, cocina, programación y filosofía. ¿Cómo es posible? ¿Tiene toda la historia de la humanidad comprimida ahí dentro?

Evidentemente no. Y este es el punto clave.

Lo que hay en esos 4 GB no es conocimiento. Son pesos matemáticos. Miles de millones de números decimales que codifican, de forma distribuida y no directamente legible, las relaciones estadísticas entre conceptos del lenguaje humano. No es una base de datos. Es una función matemática que aproxima cómo usamos las palabras.

Cómo funciona de verdad

Imagina un diccionario enorme donde, en lugar de definiciones, cada palabra tiene asignadas coordenadas en un espacio de miles de dimensiones. Palabras con significados parecidos quedan cerca en ese espacio. «Rey» y «Reina» están próximos. «Hospital» y «médico» también.

Este sistema de codificación lo llamamos «embedding» o representación vectorial.

Cuando le haces una pregunta al modelo, ocurre algo extremadamente elegante: el sistema calcula el «embedding» de la pregunta y determina qué relaciones vectoriales son relevantes para el contexto concreto de tu pregunta. No recupera una respuesta almacenada. La construye en tiempo real, token a token, priorizando las conexiones que son estadísticamente más probables dada tu pregunta.

A esto último se le llama mecanismo de atención4, y es la innovación que, a partir de 2017, cambió nuestra forma de trabajar, pues abrió la puerta a la construcción de los modelos de lenguaje que tenemos hoy en día a nuestra disposición.

El resultado puede parecer razonamiento. Puede parecer comprensión. Pero el proceso subyacente es estadístico, no lógico. Únicamente predice cúal es la siguiente palabra más probable, ni más ni menos.

Lo que quizá deberíamos plantearnos es por qué los humanos somos tan sorprendentemente predecibles (más de lo que pensamos) y un «simple» juego estadístico nos lo está demostrando cada día.

Por qué la IA «alucina» (y por qué era inevitable)

Las famosas alucinaciones —cuando la IA inventa datos, cita artículos inexistentes o atribuye frases falsas a personas reales— no son un bug que se pueda corregir en las siguientes versiones de los modelos.

Son la consecuencia directa de cómo funciona el sistema.

Cuando no existe un patrón estadístico claro sobre la respuesta correcta, el modelo genera la secuencia de tokens más probable. El resultado es coherente. Suena bien. Pero puede ser completamente falso.

La diferencia con un humano es fundamental: un humano que responde sabe por qué dice lo que dice. El modelo produce lo que es estadísticamente más probable. A veces coincide con la verdad. A veces no.

Un modelo de IA está entrenado para responder siempre, no distingue si sabe o no sabe algo, lo que es un grave problema, porque la respuesta estará bien redactada (son una serie de palabras que estadísticamente concuerdan y tienen un sentido lógico) por lo que nos puede llevar a dudar de su veracidad.

Recordemos aquel proverbio árabe que dice algo como (me permito pequeños cambios):

El que sabe y sabe que sabe, es un sabio.

El que sabe y no sabe que sabe, es un genio.

El que no sabe y sabe que no sabe, es un ignorante.

El que no sabe y no sabe que no sabe, es un necio.

Podríamos decir que la IA es el necio de esta historia, y nosotros deberíamos ser el sabio que la acompaña.

La IA es muy buena en esto y muy mala en aquello

Para ser justo, hay que reconocer lo que hace excepcionalmente bien:

- Resumir y reformular textos con gran precisión

- Generar código a partir de patrones frecuentes

- Asociar conceptos relacionados de forma creativa

- Adaptar el tono y el estilo a diferentes contextos

- Detectar patrones

Y lo que hace mal, de forma inherente:

- Verificar hechos (no tiene una base de datos de verdades)

- Razonar formalmente con lógica deductiva

- Recordar conversaciones anteriores (sin memoria externa)

- Saber cuándo no sabe algo

El debate que me parece más urgente

Hay algo que me preocupa más que el catastrofismo sobre la IA: la idea de que la programación es el pasado y que los ingenieros informáticos (aunque este mismo dilema se podría extender a cualquier rama del conocimiento) deberían reconvertirse en meros gestores.

Considero que es exactamente al revés.

La IA amplifica al ingeniero que sabe lo que hace. Los mejores prompts los escriben quienes entienden la tecnología subyacente. La arquitectura, la seguridad, el rendimiento y la deuda técnica siguen siendo problemas que requieren criterio técnico profundo, no gestión superficial.

Un gestor sin una base técnica sólida que delega todo en la IA está construyendo un castillo de arena. Un ingeniero que usa la IA como herramienta está multiplicando su capacidad de impacto.

La conclusión que quiero que te lleves

La IA generativa es una herramienta extraordinaria. Probablemente la más poderosa que hemos creado para procesar y generar lenguaje. Pero no piensa, no razona, no comprende.

Quien entienda cómo funciona podrá usarla con criterio, detectar sus errores, sacar partido real de sus capacidades y gestionar sus limitaciones. Quien no la entienda vivirá a merced de ella.

La clave diferencial del profesional del futuro no es saber usar la IA. Es entender por qué funciona como funciona.

- The Terminator. 1984. https://www.imdb.com/title/tt0088247/ ↩︎

- Marx, Karl. Elementos fundamentales para la crítica de la economía política (Grundrisse) 1857-1858. Traducido por Pedro Scaron, vol. 1, Siglo XXI Editores, 2007. ↩︎

- A. M. Turing, «I.—COMPUTING MACHINERY AND INTELLIGENCE», Mind, vol. LIX, n.o 236, pp. 433-460, oct. 1950, doi: 10.1093/mind/LIX.236.433. ↩︎

- A. Vaswani et al., «Attention is all you need», en Advances in Neural Information Processing Systems, Curran Associates, Inc., 2017. Disponible en: https://proceedings.neurips.cc/paper_files/paper/2017/hash/3f5ee243547dee91fbd053c1c4a845aa-Abstract.html ↩︎